広告効果を劇的改善!A/Bテストの始め方と実践ガイド

公開日:2026年03月30日

![[広告効果を劇的に改善!A/Bテストの始め方と実践のイメージ画像]](/images/column/cover_20260330_013349_14a41f.jpg)

目次

- A/Bテストとは何か

- A/Bテストの基本的な定義と目的

- なぜ広告効果改善にA/Bテストが不可欠なのか

- A/Bテストで検証できる要素(例:クリエイティブ、コピー、CTA、LPなど)

- A/Bテストの仕組みと基本的な考え方

- 仮説設定の重要性:何を検証し、何を期待するか

- 検証対象とコントロール:比較の原則

- 統計的有意差とテスト期間:結果の信頼性を担保する

- シングルバリアブルテストの原則:一度に一つの要素を検証する理由

- 具体的な活用方法・実践ステップ

- STEP1: 改善したい課題の特定と目標設定

- STEP2: 仮説の立案と検証要素の選定

- STEP3: テストパターンの作成(Aパターン、Bパターン)

- STEP4: テストの実施とデータ収集

- STEP5: 結果の分析と次のアクション決定

- 広告クリエイティブにおけるA/Bテストの例

- 広告コピー・見出しにおけるA/Bテストの例

- LP(ランディングページ)におけるA/Bテストの例

- よくある疑問と落とし穴

- テスト期間はどれくらい設けるべきか?

- どのくらいのサンプル数が必要か?

- 複数の要素を同時にテストしてはいけない理由

- 統計的有意差が出ない場合の対処法

- 小規模ビジネスでのA/Bテストの始め方

- よくある質問(FAQ)

- A/Bテストを始めるのに特別なツールは必要ですか?

- A/Bテストはどのような広告媒体で実施できますか?

- A/Bテストの結果が毎回同じで、改善が見られません。どうすればよいですか?

- A/Bテストは一度やれば終わりですか?

- A/Bテストと多変量テストの違いは何ですか?

- まとめ

- 参考・出典

「Web広告を出しているが、思ったように成果が伸びない」「広告費をかけているのに、費用対効果が合わない」——。地方・中小企業のマーケティング担当者や経営者の皆様から、このようなお悩みをよく伺います。勘や経験に頼った広告運用を続けていても、変化の速い市場ではすぐに競合に埋もれてしまいます。本記事では、データに基づいて広告効果を改善する強力な手法「A/Bテスト」について、その始め方から実践のステップまでを徹底解説します。この記事を読めば、明日からでも始められる具体的なノウハウが身につき、広告運用を成功へと導く道筋が見えるはずです。

A/Bテストとは何か

広告運用やWebサイト改善において、「A/Bテスト」という言葉を耳にしたことがある方は多いでしょう。しかし、その本質を正しく理解し、実践できているケースはまだ少ないのが現状です。ここでは、A/Bテストの基本から、なぜ現代のマーケティングで不可欠なのかを解説します。

A/Bテストの基本的な定義と目的

A/Bテストとは、Webサイトのページや広告クリエイティブなどで、2つの異なるパターン(AパターンとBパターン)を用意し、どちらがより高い成果を出すかを実際にユーザーに配信して検証する手法です。

例えば、広告のキャッチコピーを2種類用意し、同じターゲット層にランダムに表示させます。そして、「どちらのコピーがより多くクリックされたか(CTRが高いか)」「どちらのコピーから来たユーザーがより多く商品を購入したか(CVRが高いか)」といったデータを比較・分析します。

このテストの最終的な目的は、広告効果の最大化です。具体的には、コンバージョン率(CVR)の向上や費用対効果(ROI)の改善を目指し、データに基づいた最適なクリエイティブや訴求方法を見つけ出すことにあります。

なぜ広告効果改善にA/Bテストが不可欠なのか

デジタルマーケティングの世界では、市場のトレンドやユーザーのニーズが絶えず変化しています。昨日まで効果的だった広告が、今日には響かなくなることも珍しくありません。このような環境で成果を出し続けるためには、過去の「勘」や「経験」だけに頼るのではなく、データに基づいた客観的な意思決定が不可欠です。

A/Bテストは、まさにそのための手法です。

- 客観的な意思決定を可能にする: 「こちらの方がデザインが良いはずだ」といった主観的な判断ではなく、「実際にBパターンの方がCVRが1.5倍高かった」という事実に基づいて次の施策を決定できます。

- 小さな改善が大きな成果を生む: クリック率が0.1%改善する、コンバージョン率が1%改善するといった小さな成功の積み重ねが、長期的には売上や利益に大きなインパクトをもたらします。

- 変化への迅速な対応: ユーザーの反応を直接データで確認できるため、市場の変化に素早く気づき、広告戦略を常に最適化し続けることができます。

単に「どちらが良いか」を決めるだけでなく、「なぜ良いのか」という学びを得て、それを次の施策に活かす。この継続的な改善サイクルこそが、A/Bテストの真価なのです。

A/Bテストで検証できる要素(例:クリエイティブ、コピー、CTA、LPなど)

A/Bテストは、ユーザーとの接点となる様々な要素で実施可能です。特に広告運用においては、以下のような要素が主な検証対象となります。

- 広告クリエイティブ:

- 画像(人物写真 vs 商品写真、イラスト vs 実写)

- 動画(冒頭の3秒、動画の長さ、テロップの有無)

- バナー広告の色調やデザイン

- 広告コピー:

- タイトル、見出し(価格訴求 vs 機能訴求、メリット強調 vs 課題解決)

- 説明文(具体的な数字を入れる vs 感情に訴えかける)

- CTA(Call To Action):

- ボタンの文言(「詳しくはこちら」 vs 「無料で試す」)

- ボタンの色や形、配置

- ランディングページ(LP):

- ファーストビューの画像やキャッチコピー

- コンテンツの構成や順序

- フォームの入力項目数やデザイン

- WebサイトのUI/UX要素:

- ナビゲーションのメニュー構成

- 商品一覧ページの表示形式

これらの要素を一つひとつテストし、最適化していくことで、広告キャンペーン全体のパフォーマンスを劇的に向上させることが可能です。

A/Bテストの仕組みと基本的な考え方

A/Bテストを単なる「試行錯誤」で終わらせず、科学的で信頼性の高い改善活動にするためには、その背景にある基本的な考え方を理解することが重要です。ここでは、テストを成功に導くための3つの重要な概念を解説します。

仮説設定の重要性:何を検証し、何を期待するか

効果的なA/Bテストは、必ず明確な「仮説」から始まります。仮説とは、「もし〇〇という要素を△△のように変更すれば、ユーザーの行動が□□のように変わり、結果として☆☆という指標が改善されるだろう」という、具体的な予測のことです。

悪い仮説の例:「ボタンの色を赤にしたら、クリックが増えるかもしれない」 良い仮説の例:「現在の青いボタンは背景に埋もれて目立たない。そこで、補色であるオレンジ色に変更すれば、ユーザーの視線を引きつけてボタンの存在に気づかせ、結果としてクリック率が3%向上するだろう」

良い仮説には、「現状の課題分析」「具体的な変更案」「期待されるユーザー行動の変化」「測定可能な目標」が含まれています。仮説が明確であればあるほど、テストの設計がしやすくなり、得られた結果から深い学びを得ることができます。

検証対象とコントロール:比較の原則

A/Bテストでは、比較の基準となるコントロール(Aパターン:現状のバージョン)と、仮説に基づいて変更を加えたバリアント(Bパターン:新しいバージョン)を用意します。

ここで最も重要な原則は、「比較したい要素以外は、すべての条件を同じにする」ことです。例えば、広告コピーのテストをしたいのに、AパターンとBパターンで画像まで変えてしまうと、成果に差が出た場合に「コピーが良かったのか、画像が良かったのか」が判断できません。

ターゲットオーディエンス、配信期間、予算、リンク先のLPなど、検証したい1つの要素以外は完全に同一の条件でテストを実施することで、初めてその要素が与えた影響を正確に測定できます。

統計的有意差とテスト期間:結果の信頼性を担保する

テストの結果、BパターンのCVRがAパターンを上回ったとします。しかし、その差は本当にBパターンが優れていたからでしょうか?それとも、単なる「偶然」の結果でしょうか?

この「偶然ではない、意味のある差」であることを示すのが「統計的有意差」という考え方です。一般的に「有意水準95%」などの基準が用いられ、これは「もしAとBに本当は差がないとしたら、今回観測されたような差が偶然生まれる確率は5%未満である」という意味です。

この統計的有意差を確保するためには、十分なサンプルサイズ(データ量)とテスト期間が必要です。データが少なすぎると、数件のコンバージョンによって結果が大きくぶれてしまい、信頼できる結論は導き出せません。テスト期間も、曜日や時間帯によるユーザー行動の変動をならすため、最低でも1〜2週間、できれば1ヶ月程度の期間を設けることが推奨されます。

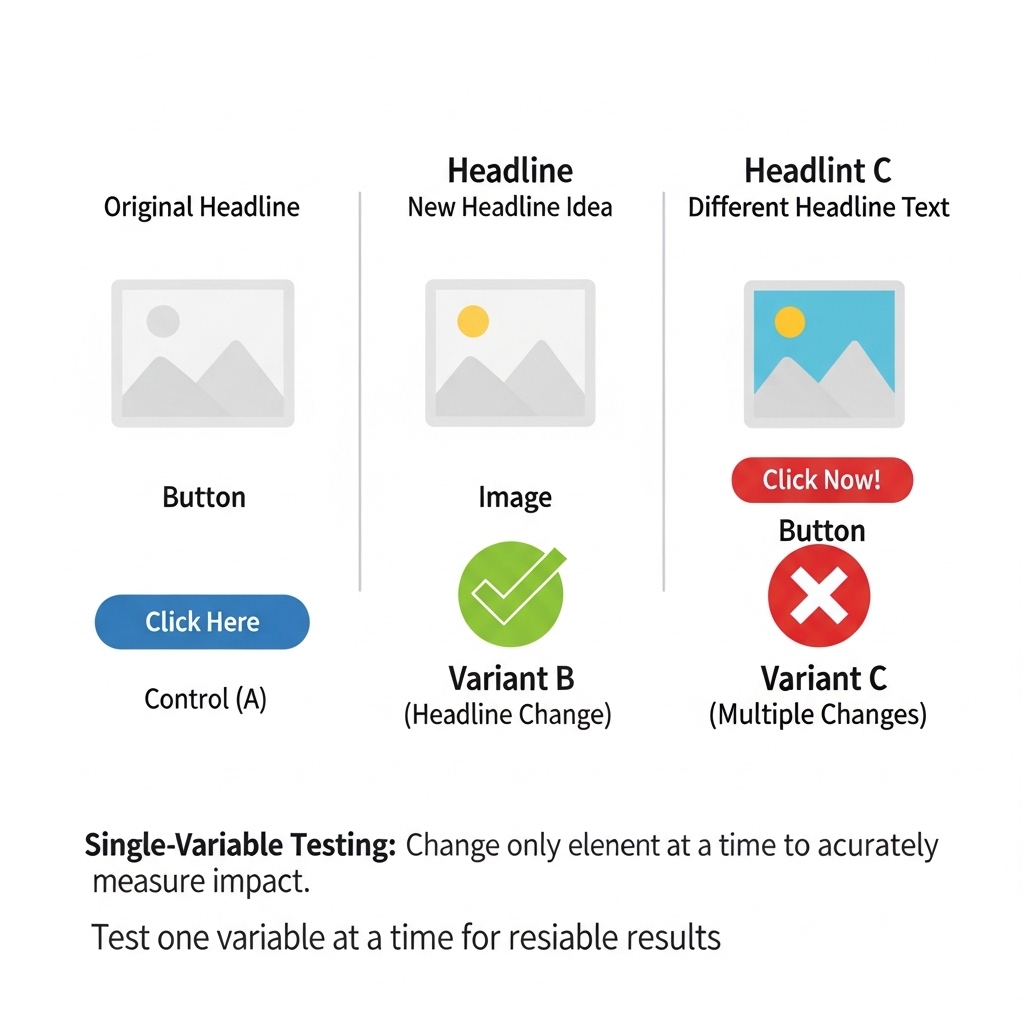

シングルバリアブルテストの原則:一度に一つの要素を検証する理由

前述の「比較の原則」とも関連しますが、効果的な改善サイクルを回すためには「一度に一つの要素だけを検証する(シングルバリアブルテスト)」ことが鉄則です。

「早く成果を出したい」という焦りから、キャッチコピーと画像とボタンの色を一度に全部変えたくなるかもしれません。しかし、それで成果が上がったとしても、どの変更が本当に効果的だったのかを特定できません。逆に成果が下がった場合も、原因が分からず、次の改善に繋がる学びを得られません。

地道に思えるかもしれませんが、一つの要素をテストし、勝ったパターンを新しいコントロールとして採用し、また次の要素をテストする。このサイクルを繰り返すことが、広告効果を着実に積み上げていく最も確実な方法なのです。

具体的な活用方法・実践ステップ

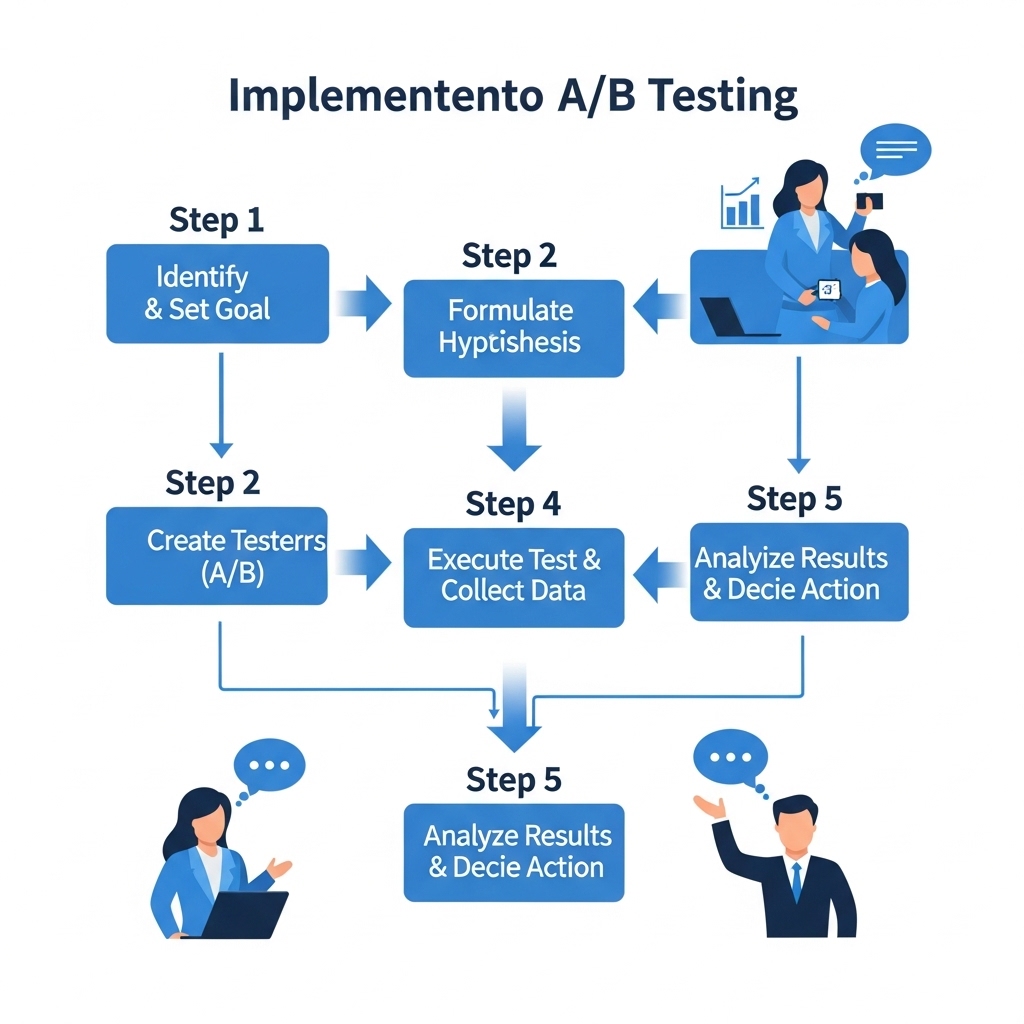

理論を理解したところで、次は実際にA/Bテストを広告運用に導入するための具体的なステップを見ていきましょう。以下の5つのステップに沿って進めることで、誰でも体系的にA/Bテストを実践できます。

STEP1: 改善したい課題の特定と目標設定

まずは、現状の広告パフォーマンスを分析し、どこに改善の余地があるか(ボトルネック)を特定します。

- 課題の例:

- 広告は表示されているが、クリック率(CTR)が業界平均より低い。

- クリックはされるが、ランディングページからのコンバージョン率(CVR)が低い。

- 特定の広告クリエイティブの成果が著しく悪い。

課題を特定したら、そのA/Bテストで何を達成したいのか、具体的な数値目標(KPI)を設定します。

- 目標の例:

- 広告見出しのA/Bテストを行い、CTRを0.5%から0.8%に向上させる。

- LPのファーストビューのA/Bテストを行い、CVRを1%から1.5%に改善する。

STEP2: 仮説の立案と検証要素の選定

次に、STEP1で特定した課題を解決するための仮説を立てます。ユーザーの視点に立ち、「なぜこの課題が起きているのか?」「どうすれば解決できるか?」を考えます。

- 課題: CTRが低い

- 仮説: 現在の広告見出しは製品の機能説明に終始しており、ユーザーの課題に寄り添えていない。そこで、「〇〇で悩んでいませんか?」という問いかけ型の見出しにすれば、自分ごととして捉えられ、クリック率が向上するだろう。

- 検証要素: 広告見出し

この段階で、最もインパクトが大きく、かつ改善効果が見込まれる検証要素を一つだけに絞り込みます。

STEP3: テストパターンの作成(Aパターン、Bパターン)

仮説に基づき、具体的なテストパターンを作成します。

- Aパターン(コントロール): 現在使用している広告

- 見出し: 「高機能な会計ソフト Model X」

- Bパターン(バリアント): 仮説に基づいて変更を加えた広告

- 見出し: 「毎月の経理作業に追われていませんか?」

ここで重要なのは、検証要素である「見出し」以外(画像、説明文、リンク先など)は、AパターンとBパターンで完全に同一にすることです。

STEP4: テストの実施とデータ収集

準備が整ったら、広告プラットフォームでテストを開始します。

広告プラットフォーム(Google広告、Facebook広告など)での設定方法

多くの広告プラットフォームには、A/Bテストを簡単に行うための機能が備わっています。

- Google広告: 「広告のバリエーション」機能や「テスト」機能(旧称:キャンペーンのテスト)を利用します。同じ広告グループ内で複数の広告を作成し、広告のローテーション設定を「均等に配信」にすることでも簡易的なテストが可能です。

- Facebook広告(Meta広告): 広告セットの階層で「A/Bテストを作成」を選択します。変数(クリエイティブ、オーディエンス、配置など)を選び、テストを設計します。

適切なターゲット設定と予算配分

テストの対象となるオーディエンスが、本来のターゲットと乖離しないように注意します。また、AパターンとBパターンに公平に予算が配分され、均等に表示されるように設定することが重要です。プラットフォームのテスト機能を使えば、通常は自動で均等に配信されます。

テスト期間は、統計的に信頼できるデータを収集するため、最低でも2週間〜1ヶ月程度を目安に実施しましょう。週末と平日でユーザー行動が異なる場合も多いため、最低でも1〜2回のサイクルが含まれる期間を設定することが望ましいです。

STEP5: 結果の分析と次のアクション決定

テスト期間が終了したら、収集したデータを分析し、どちらのパターンが優れていたかを判断します。

GA4などでの効果測定と分析

広告プラットフォームの管理画面だけでなく、Google Analytics 4 (GA4) などのアクセス解析ツールも活用し、多角的に効果を測定します。 CTRやCVRだけでなく、LPでの滞在時間、直帰率、マイクロコンバージョン(資料請求など)といった中間指標も比較することで、より深い洞察が得られます。詳しい分析方法は、GA4を使いこなす!ユーザー行動分析で売上向上術も参考にしてください。

分析の際は、必ず統計的有意差を確認します。多くの広告プラットフォームでは、テスト結果画面で有意差があるかどうかを示してくれます。もし手動で計算する場合は、Web上で利用できる無料の有意差検定ツールなどを活用しましょう。

成功パターンの採用とさらなる改善

- 優位な差が出た場合: 成果の良かったパターン(ウィニングパターン)を本採用し、広告を全面的に切り替えます。そして、今回得られた「問いかけ型の見出しは効果が高い」といった学びを、他の広告キャンペーンやメールマガジンなどにも応用します。

- 差が出なかった・悪化した場合: これも重要な学びです。「今回の仮説は間違っていた」という事実がわかったのですから、なぜダメだったのかを考察し、新たな仮説を立てて次のテストに繋げます。

この「テスト→分析→学習→次のテスト」というサイクルを継続的に回すことが、広告効果を劇的に改善する鍵となります。

広告クリエイティブにおけるA/Bテストの例

- 画像: 人物が写っている画像 vs 商品のみの画像

- 動画: 実写のユーザーインタビュー動画 vs アニメーションによる機能説明動画

- 色調: 明るくポップなデザイン vs 信頼感を訴求する落ち着いたデザイン

広告コピー・見出しにおけるA/Bテストの例

- 訴求軸: 価格の安さを強調するコピー vs 製品利用後の未来を想像させるコピー

- 表現: 「満足度98%」など具体的な数字を入れる vs 「多くのお客様に選ばれています」という抽象的な表現

- 長さ: 短く簡潔な見出し vs 詳細を説明する長めの見出し

LP(ランディングページ)におけるA/Bテストの例

- ファーストビュー: キャッチコピーやメインビジュアルの変更

- CTAボタン: ボタンの文言(「無料相談はこちら」 vs 「今すぐ資料請求」)、色、配置の変更

- フォーム: 入力項目を5つから3つに減らす

LPの改善については、Webサイト改善!中小企業が取り組むべきCVR施策の記事でより詳しく解説しています。

Kotoba マーケティング支援

月5万円から、マーケティングの全領域をプロがサポート

戦略立案・SNS運用・Web広告・コンテンツSEOまで、一気通貫で対応。まずはサービス概要資料か、無料個別相談からどうぞ。

資料ダウンロード・個別相談、いずれも無料です。

よくある疑問と落とし穴

A/Bテストをいざ始めようとすると、様々な疑問や壁にぶつかります。ここでは、多くの担当者が陥りがちな失敗パターンとその対策を解説します。

テスト期間はどれくらい設けるべきか?

短すぎると偶然の結果に左右され、長すぎると機会損失に繋がります。 一般的な目安としては、最低でも1〜2週間、できれば1ヶ月を推奨します。これは、曜日によるユーザー行動の違い(例:平日はBtoB、週末はBtoCが活発)や、給料日後のような特定の周期の影響を平準化するためです。また、信頼できる結果を得るためには、後述する十分なサンプル数を確保できる期間が必要です。

どのくらいのサンプル数が必要か?

一概に「〇件以上」とは言えませんが、統計的有意差が検出できるだけのデータ量が必要です。 コンバージョン数が各パターンで数件しかない状態では、信頼できる判断は下せません。少なくとも各パターンで数十件、理想を言えば100件以上のコンバージョンが欲しいところです。 アクセス数が少ない中小企業のサイトでは、十分なコンバージョン数を集めるのが難しい場合もあります。その際は、コンバージョンに近い行動(例:フォーム入力開始、カート追加など)をマイクロコンバージョンとして設定し、それを目標にテストを行うのも一つの手です。

複数の要素を同時にテストしてはいけない理由

これはA/Bテストで最もよくある間違いの一つです。キャッチコピーと画像を同時に変更して成果が上がったとしても、「キャッチコピーが良かったのか、画像が良かったのか、あるいはその組み合わせが良かったのか」が全く分かりません。 これでは、次に繋がる有効な「学び」を得ることができず、再現性のない、その場しのぎの改善になってしまいます。必ず「一度に一つの要素(シングルバリアブル)」の原則を守りましょう。

統計的有意差が出ない場合の対処法

テストの結果、「どちらのパターンも大差ない」という結論になることもあります。その場合は、以下の可能性を考えましょう。

- 変更が小さすぎた: ユーザーが気づかないほどの小さな変更(例:句読点の有無など)では、行動に変化は起きにくいです。もっと大胆な変更を試しましょう。

- 仮説が間違っていた: そもそもユーザーが重要視していない要素をテストしてしまった可能性があります。ユーザーアンケートやアクセス解析データを見直し、仮説を再構築しましょう。

- テスト期間やサンプル数が不足している: もう少しテストを続ければ差が出る可能性もあります。

重要なのは、「差がない」という結果も「この変更では効果がないことが分かった」という立派な学びであると捉えることです。

小規模ビジネスでのA/Bテストの始め方

高価な専用ツールを導入しなくても、A/Bテストは始められます。

- 広告プラットフォームの標準機能を使う: Google広告やMeta広告に標準で搭載されているテスト機能を活用すれば、追加費用なしで実施できます。

- インパクトの大きい要素から始める: まずは広告の「見出し」やLPの「キャッチコピー」など、最も成果に影響を与えそうな要素からテストを始めましょう。

- 期間で比較する: 厳密なA/Bテストではありませんが、リソースが限られる場合、月前半と月後半で広告クリエイティブを切り替え、成果を比較するという簡易的な方法もあります。(※季節要因などの影響を受けるため注意が必要です)

重要なのは、完璧を目指すことよりも、まずは小さく始めて改善のサイクルを回し始めることです。

よくある質問(FAQ)

A/Bテストを始めるのに特別なツールは必要ですか?

必ずしも必要ではありません。Google広告やFacebook広告(Meta広告)など、多くの主要な広告プラットフォームには、標準でA/Bテスト機能が搭載されています。まずはこれらの機能を活用することから始めるのがおすすめです。より高度なLPのテストを行いたい場合は、専用のA/Bテストツールを導入すると効率的です。

A/Bテストはどのような広告媒体で実施できますか?

検索広告、ディスプレイ広告、SNS広告(Facebook, Instagram, Xなど)、動画広告など、デジタル広告のほとんどの媒体で実施可能です。各プラットフォームの仕様に合わせて、クリエイティブ、コピー、ターゲティングなどの要素をテストできます。

A/Bテストの結果が毎回同じで、改善が見られません。どうすればよいですか?

テストによる改善が見られない場合、2つの可能性があります。一つは、テストしている変更がユーザーの行動に影響を与えるほど大きなものではないケースです。ボタンの色の微調整などではなく、訴求の切り口やメインビジュアルといった、より根本的な要素のテストを試みてください。もう一つは、そもそも仮説がユーザーインサイトからずれている可能性です。データ分析やユーザー調査に戻り、仮説の質を高めることが重要です。

A/Bテストは一度やれば終わりですか?

いいえ、A/Bテストは一度で終わるものではありません。市場環境やユーザーのニーズは常に変化するため、継続的に仮説検証を繰り返し、改善のサイクルを回し続けることが重要です。一つのテストで成功したパターンを新たな基準(コントロール)とし、さらに良いパターンを探すことで、持続的な成果向上が可能になります。

A/Bテストと多変量テストの違いは何ですか?

A/Bテストは、2つの異なるパターン(AとB)を比較するシンプルなテストです。一方、多変量テストは、複数の要素(例:見出し、画像、CTAボタン)の複数のバリエーションを同時にテストし、どの組み合わせが最も効果的かを検証する手法です。多変量テストはより複雑な分析が可能ですが、有意な結果を得るためには非常に多くのトラフィックが必要となるため、まずはA/Bテストから始めるのが一般的です。

まとめ

本記事では、広告効果を劇的に改善するためのA/Bテストについて、その基本から具体的な実践ステップ、よくある疑問までを網羅的に解説しました。

A/Bテストは、単に2つのパターンを比較するだけの作業ではありません。「仮説を立て、実行し、データで検証し、学んだことを次に活かす」という、科学的な改善サイクルをビジネスに導入するための強力なフレームワークです。

勘や経験に頼った広告運用は、いわば地図を持たずに航海に出るようなものです。A/Bテストという羅針盤を手にすることで、データに基づいた客観的な意思決定が可能になり、広告の費用対効果を最大化し、着実な事業成長へと繋げることができます。

もちろん、日々の業務に追われる中で、継続的に仮説を立て、テストを設計・分析し続けるのは容易なことではありません。特に地方・中小企業では、専門知識を持つ人材やリソースの確保が大きな課題となるでしょう。しかし、今日からでも始められる小さな一歩があります。まずは最も課題だと感じている広告の見出しを一つだけ変えてみることから、ぜひ実践してみてください。その小さなテストの積み重ねが、将来の大きな成功への第一歩となるはずです。

参考・出典

Kotoba マーケティング支援

月5万円から、マーケティングの全領域をプロが一気通貫でサポートします。

戦略立案からSNS運用・Web広告・コンテンツSEOまで対応。

「何から手をつければいいかわからない」という段階から一緒に考えます。

資料ダウンロード・個別相談、いずれも無料です。